За BMS, BUS, индустриски, инструментален кабел.

Илон Маск и тимот на xAI официјално ја лансираа најновата верзија на Grok, Grok3, за време на пренос во живо. Пред овој настан, значителна количина поврзани информации, заедно со 24/7 промотивната возбуда на Маск, ги подигнаа глобалните очекувања за Grok3 на невидени нивоа. Само пред една недела, Маск самоуверено изјави за време на пренос во живо, коментирајќи го DeepSeek R1: „xAI е на пат да лансира подобар модел на вештачка интелигенција“. Од податоците презентирани во живо, Grok3 наводно ги надминал сите тековни мејнстрим модели во реперите за математика, наука и програмирање, а Маск дури тврдел дека Grok3 ќе се користи за пресметковни задачи поврзани со мисиите на SpaceX на Марс, предвидувајќи „пробиви на ниво на Нобелова награда во рок од три години“. Сепак, ова се само тврдења на Маск. По лансирањето, ја тестирав најновата бета верзија на Grok3 и го поставив класичното трик прашање за големи модели: „Кој е поголем, 9.11 или 9.9?“ За жал, без никакви квалификации или оценки, таканаречениот најпаметен Grok3 сè уште не можеше правилно да одговори на ова прашање. Grok3 не успеа точно да го идентификува значењето на прашањето.

Овој тест брзо привлече значително внимание од многу пријатели, и случајно, разни слични тестови во странство покажаа дека Grok3 се бори со основни прашања од физика/математика како „Која топка паѓа прва од Кривата кула во Пиза?“ Така, хумористично е етикетиран како „гениј кој не е спремен да одговара на едноставни прашања“.

Grok3 е добар, но не е подобар од R1 или o1-Pro.

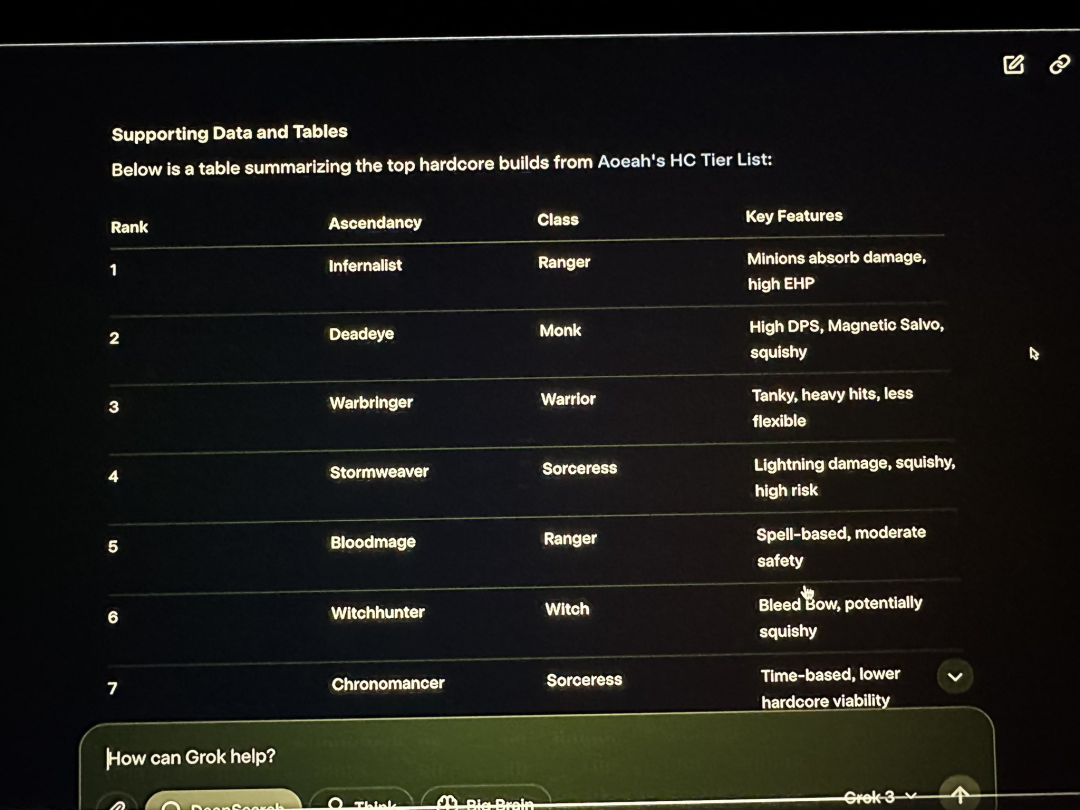

Grok3 доживеа „неуспеси“ на многу тестови за општо знаење во пракса. За време на настанот за лансирање на xAI, Маск демонстрираше користење на Grok3 за анализа на класите на ликови и ефектите од играта Path of Exile 2, за која тврдеше дека често ја игра, но повеќето од одговорите дадени од Grok3 беа неточни. Маск за време на преносот во живо не го забележа овој очигледен проблем.

Оваа грешка не само што обезбеди дополнителни докази за странските корисници на интернет да му се потсмеваат на Маск за „наоѓање замена“ во гејмингот, туку и покрена значителни загрижености во врска со сигурноста на Grok3 во практичните апликации. За таков „гениј“, без оглед на неговите вистински можности, неговата сигурност во екстремно сложени сценарија за примена, како што се задачите за истражување на Марс, останува под знак прашалник.

Моментално, многу тестери кои добија пристап до Grok3 пред неколку недели, и оние кои ги тестираа можностите на моделот неколку часа вчера, сите укажуваат на заеднички заклучок: „Grok3 е добар, но не е подобар од R1 или o1-Pro“.

Критичка перспектива за „нарушувањето на Nvidia“

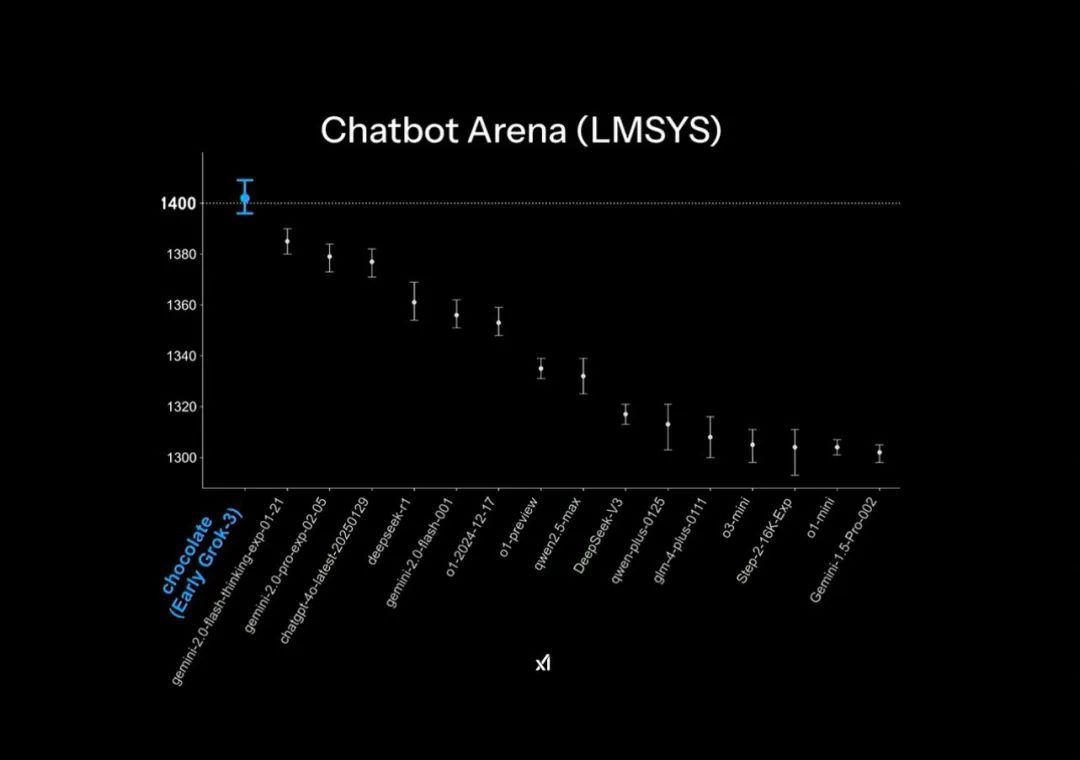

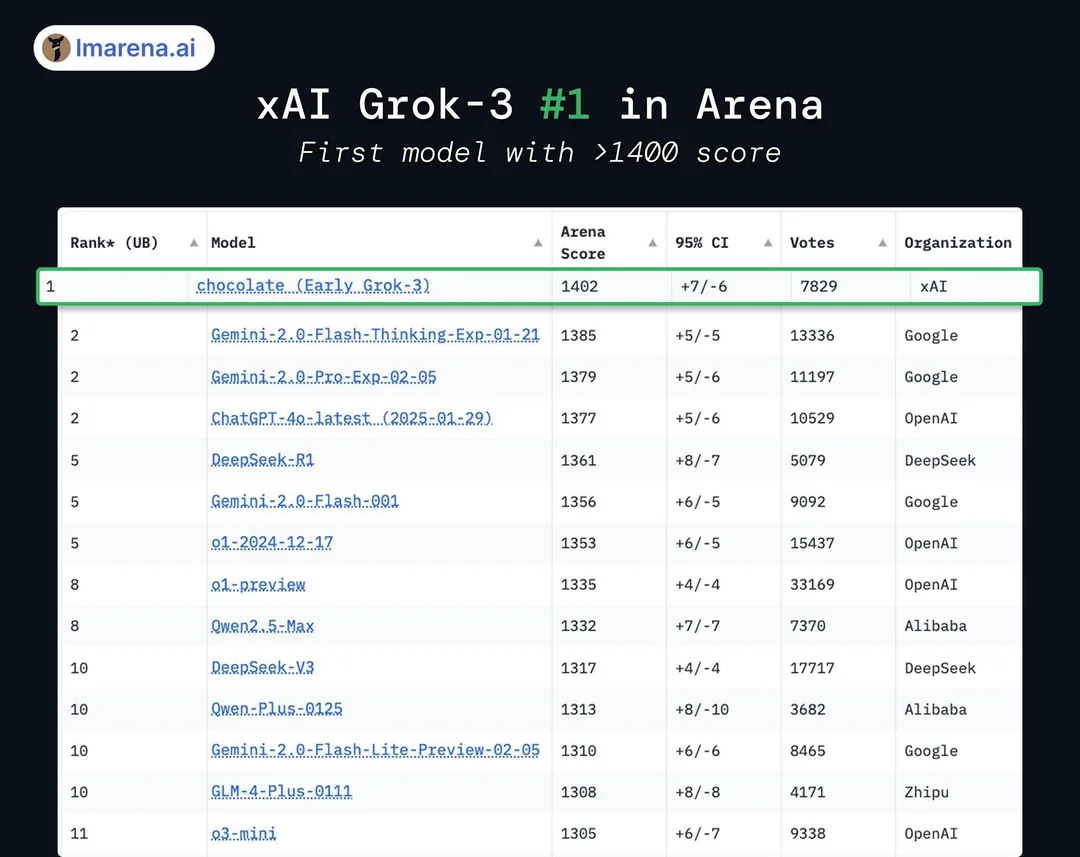

Во официјално презентираната PPT презентација за време на објавувањето, Grok3 беше прикажан како „далеку понапред“ во Chatbot Arena, но ова паметно користеше графички техники: вертикалната оска на табелата со резултати прикажуваше само резултати во опсегот на резултати од 1400-1300, што ја прави оригиналната разлика од 1% во резултатите од тестот да изгледа исклучително значајна во оваа презентација.

Во реалните резултати од оценувањето на моделите, Grok3 е само 1-2% пред DeepSeek R1 и GPT-4.0, што одговара на искуствата на многу корисници во практичните тестови кои „не пронајдоа забележлива разлика“. Grok3 ги надминува своите наследници само за 1%-2%.

Иако Grok3 постигна повисок резултат од сите јавно тестирани модели, многумина не го сфаќаат ова сериозно: на крајот на краиштата, xAI претходно беше критикуван за „манипулација со резултатите“ во ерата на Grok2. Бидејќи табелата со резултати го казнуваше стилот на должина на одговорите, резултатите значително се намалија, што ги наведе инсајдерите во индустријата често да го критикуваат феноменот „висок резултат, но ниска способност“.

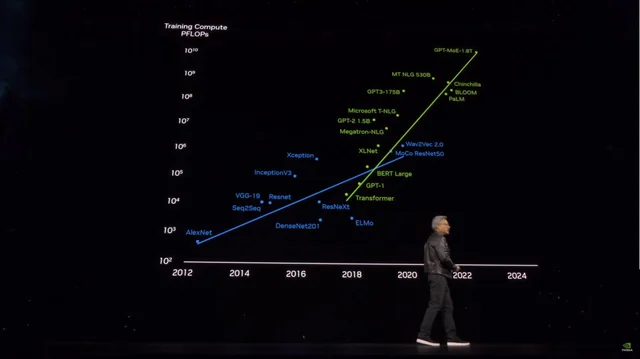

Без разлика дали преку „манипулација“ на таблата со водачи или дизајнерски трикови во илустрациите, тие ја откриваат xAI и опсесијата на Маск со идејата за „водење на групата“ во можностите на моделите. Маск плати висока цена за овие маржи: за време на лансирањето, тој се пофали со користење на 200.000 H100 графички процесори (тврдејќи дека има „над 100.000“ за време на преносот во живо) и постигнување вкупно време на обука од 200 милиони часа. Ова ги наведе некои да веруваат дека ова претставува уште еден значаен благодет за индустријата за графички процесори и да го сметаат влијанието на DeepSeek врз секторот за „глупаво“. Имено, некои веруваат дека чистата компјутерска моќ ќе биде иднината на обуката на моделите.

Сепак, некои корисници на интернет ја споредија потрошувачката на 2000 графички процесори H800 во текот на два месеци за да го произведат DeepSeek V3, пресметувајќи дека вистинската потрошувачка на енергија за тренинг на Grok3 е 263 пати поголема од V3. Разликата помеѓу DeepSeek V3, кој освои 1402 поени, и Grok3 е нешто под 100 поени. По објавувањето на овие податоци, многумина брзо сфатија дека зад титулата на Grok3 како „најсилен во светот“ лежи јасен ефект на маргинална корисност - логиката на поголемите модели што генерираат посилни перформанси почна да покажува намалени приноси.

Дури и со „високи резултати, но ниска способност“, Grok2 имаше огромни количини на висококвалитетни податоци од прва страна од платформата X (Twitter) за поддршка на употребата. Сепак, при обуката на Grok3, xAI природно се соочи со „плафонот“ со кој се соочува OpenAI во моментов - недостатокот на премиум податоци за обука брзо ја разоткрива маргиналната корисност на можностите на моделот.

Развивачите на Grok3 и Маск веројатно се првите што длабоко ги разбираат и идентификуваат овие факти, поради што Маск постојано споменува на социјалните медиуми дека верзијата што корисниците ја доживуваат сега е „сè уште само бета“ и дека „целосната верзија ќе биде објавена во наредните месеци“. Маск ја презеде улогата на менаџер за производи на Grok3, предлагајќи им на корисниците да дадат повратни информации за различни проблеми со кои се соочуваат во делот за коментари. Тој можеби е најследениот менаџер за производи на Земјата.

Сепак, во рок од еден ден, перформансите на Grok3 несомнено предизвикаа тревога кај оние кои се надеваа дека ќе се потпрат на „масивна компјутерска сила“ за да тренираат посилни големи модели: врз основа на јавно достапните информации од Microsoft, GPT-4 на OpenAI има големина на параметар од 1,8 трилиони параметри, над десет пати поголема од GPT-3. Гласините сугерираат дека големината на параметарот на GPT-4.5 може да биде уште поголема.

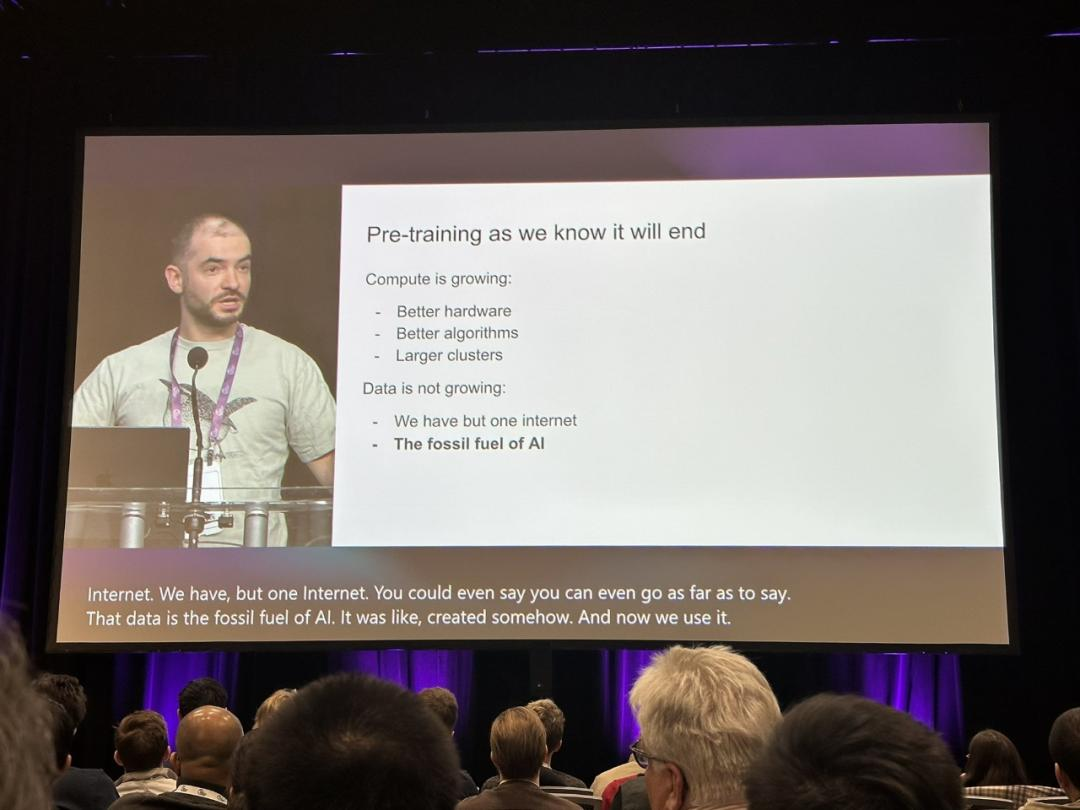

Како што големините на параметрите на моделот растат, така и трошоците за обука вртоглаво растат. Со присуството на Grok3, конкуренти како GPT-4.5 и други кои сакаат да продолжат да „трошат пари“ за да постигнат подобри перформанси на моделот преку големината на параметрите, мора да го земат предвид плафонот што сега е јасно на повидок и да размислат како да го надминат. Во овој момент, Илја Сутскевер, поранешен главен научник во OpenAI, претходно изјави минатиот декември: „Претходната обука со која сме запознаени ќе заврши“, што повторно се појави во дискусиите, поттикнувајќи напори да се пронајде вистинскиот пат за обука на големи модели.

Гледиштето на Иља го вклучи алармот во индустријата. Тој точно го предвиде неизбежното исцрпување на достапните нови податоци, што доведе до ситуација каде што перформансите не можат да продолжат да се подобруваат преку собирање податоци, споредувајќи го тоа со исцрпувањето на фосилните горива. Тој посочи дека „како нафтата, содржината генерирана од човекот на интернет е ограничен ресурс“. Според предвидувањата на Сутскевер, следната генерација модели, по претходната обука, ќе поседуваат „вистинска автономија“ и способности за расудување „слични на човечкиот мозок“.

За разлика од денешните претходно обучени модели кои првенствено се потпираат на совпаѓање на содржината (врз основа на претходно научената содржина на моделот), идните системи со вештачка интелигенција ќе можат да учат и да воспоставуваат методологии за решавање проблеми на начин сличен на „размислувањето“ на човечкиот мозок. Човекот може да постигне фундаментална вештина во одредена тема само со основна стручна литература, додека голем модел со вештачка интелигенција бара милиони точки на податоци за да се постигне само најосновната ефикасност на почетно ниво. Дури и кога формулацијата е малку изменета, овие фундаментални прашања можеби нема да бидат правилно разбрани, што илустрира дека моделот навистина не се подобрил во интелигенцијата: основните, но нерешливи прашања споменати на почетокот на статијата претставуваат јасен пример за овој феномен.

Заклучок

Сепак, покрај грубата сила, ако Grok3 навистина успее да ѝ открие на индустријата дека „претходно обучените модели се приближуваат кон својот крај“, тоа би имало значајни импликации за оваа област.

Можеби откако постепено ќе стивне возбудата околу Grok3, ќе бидеме сведоци на повеќе случаи како примерот на Феи-Феи Ли за „подесување модели со високи перформанси на специфичен сет на податоци за само 50 долари“, со што на крајот ќе се открие вистинскиот пат до AGI.

Контролни кабли

Структуриран кабелски систем

Мрежа и податоци, оптички кабел, спојувачки кабел, модули, предна плоча

16-18 април 2024 година, Блискоисточна енергија во Дубаи

16-18 април 2024 година, Securika во Москва

9 мај 2024 година, настан за лансирање на нови производи и технологии во Шангај

22-25 октомври 2024 година, SECURITY CHINA во Пекинг

19-20 ноември 2024 година, ПОВРЗАНИОТ СВЕТ, Јужна Африка

Време на објавување: 19 февруари 2025 година